ホーム

37フォロー

2033フォロワー

ChatGPTは「ヒューマンインターフェース」をどう変えるか

暦本 純一東京大学情報学環教授 「妄想する頭思考する手」

おお久しぶりに落合くんと話せて楽しかった&一瞬で終わってしまいましたw 楽しんでいただけたら幸いです。ぜひChatGPTと遊んでAIとお友達になってください。

人間拡張+AI (huam-AI Integration)については、東京大学暦本研究室ホームページ、および 東京大学ヒューマンオーグメンテーション社会連携講座のサイトをごらんください(ブックレットを無料ダウンロードできます):

https://lab.rekimoto.org/about/

https://humanaugmentation.jp/

対談の後半で触れました、ソニーコンピュータサイエンス研究所京都研究室のデジタルで拡張されたお茶室「寂隠」の情報はこちらをご参照ください:

https://www.sonycsl.co.jp/press/prs20230227/

寂隠の名前の元となりました Jack-inにつきましては、Neuromancerの作者でサイバーパンクSFの開祖でもあるWilliam Gibson さんとの対談を御覧ください:

https://www.sony.com/ja/brand/stories/ja/our/products_services/sonycsl-ha/

やらない理由を探すのではなく「見る前に跳べ」|東京大学教授 暦本純一

暦本 純一東京大学情報学環教授 「妄想する頭思考する手」

Leap before You Look (見る前に跳べ)は米詩人 W. Audenの詩から引いています。

望むなら見れば良い、でも君は跳ばなければならなくなる。

Look if you like, but you will have to leap.

W. Auden

ちなみに、記事中にあった、小学生のときに本屋さんで教えてもらったコンピュータの教科書というのは、竹内均先生の「やさしいコンピュータ」でした。竹内先生は地球物理学の権威で科学雑誌Newtonの創始者でもありますね。https://www.amazon.co.jp/%E3%82%84%E3%81%95%E3%81%97%E3%81%84%E3%82%B3%E3%83%B3%E3%83%94%E3%83%A5%E3%83%BC%E3%82%BF%E3%83%BC%E2%80%95%E3%83%97%E3%83%AD%E3%82%B0%E3%83%A9%E3%83%A0%E3%81%97%E3%82%88%E3%81%86-1969%E5%B9%B4-%E7%AB%B9%E5%86%85-%E5%9D%87/dp/B000JA3ELI

Metaの仮想空間「Horizon Worlds」、ユーザー獲得に苦戦か

暦本 純一東京大学情報学環教授 「妄想する頭思考する手」

イノベーションの本質は「新しいもの」というよりも、「それが来てしまうと今までが古くて不自然だったと気づくもの」だと思っています。が、Horizon Worldはそこまで行けてなくて、むしろ不自然さのほうが気になってしまいます。

もしリモート会議や遠隔コラボレーションの次世代を想定しているのだとすると、アバターになるのが嬉しいかどうか以前に、世界に没入「しなければならない」こと自体に課題があって、ローカル側の資料や画面にアクセスできなくなるのが致命的。zoomであっても、zoom画面のみで会議しろと言われるとつらいわけで、周りに自分の画面を出したりできるとことが重要であったりします。「それも全部VR空間の中に表示すれば」という方法もありえますが、さらに不自然さが積み上がってしまうような。

「東京一極集中が日本を救っている」といえる理由

暦本 純一東京大学情報学環教授 「妄想する頭思考する手」

リモートワーク可能な場合どこに住みたいですか、というアンケートをとっても東京が一位になるらしいので、東京一極集中が好きな方は依然として多いのかと想像します。ただ、東京の出生率は県別ランキングで最下位なので、東京一極集中がさらに進んだ場合、少子高齢化の傾向はさらに促進し、日本の人口が消滅する時期も早まるでしょう。経済発展のためにある程度の人口集積は必要ですが、それが東京しかないとなると大震災が来たら一撃で終わりかもしれません。世界的にみても東京(首都圏)並のメガシティはむしろまれで、イノベーションの中心地であるサンフランシスコ、シリコンバレーは数百万人程度、というのは示唆するところがあると思います。

レストランの多様性についても触れられていますが、たしかに人口集積はそういった多様性を支えることができる反面、一極集中による土地代の上昇がレストランの固定費を圧迫している、ということも言えると思います。東京を歩いていても、大手チェーン店だらけで、個性的な喫茶店や個人経営のレストランがめっきり減ってしまったように思います。

NORMAL

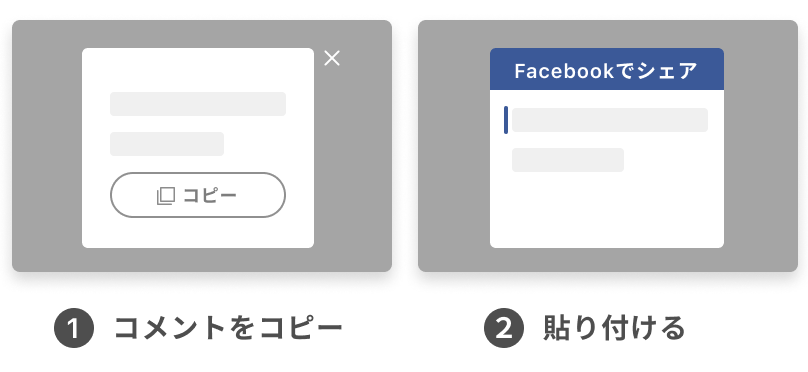

投稿したコメント