ホーム

147フォロー

1613フォロワー

毎朝スタバのコーヒーを飲む上司。コンビニの「100円」コーヒーを買う場合と比べ、年間でどれだけ多くの金額を払っているのでしょうか?

永吉 健一株式会社みんなの銀行 取締役頭取

コーヒーもタバコと一緒の「嗜好品」、つまりその人が精神的に満足や快楽を得るために摂取するモノなので、コンビニのコーヒーでは得られない満足を買っていると思えば、お金の多寡はあまり関係ないのでしょう。何にお金を遣うか、価値を見出すかは人それぞれですからね。

ただ、惰性で飲んでいるのであれば、結構な金額差になるので他の楽しみに振り向けることはできそうですw

(私も気になる支出には、#(ハッシュタグ※)をつけて、たまに振り返るようにしています)

※Record機能

https://www.minna-no-ginko.com/guide/unique/record/

インドで注目のFintechアプリ「CRED」:ユーザの利用頻度増加のカギと今後の目論見は?(滝沢頼子) - エキスパート

永吉 健一株式会社みんなの銀行 取締役頭取

2024年には中国を抜いて人口世界一になると言われているインド(14億人)。

「インディア・スタック」と呼ばれる、フィンテックや民間企業が独自のプロダクトやサービスを開発するために利用できるオープンソースプラットフォームを構築し、国策としてデジタルエコシステムによる国民生活の向上を目指しています。

そのような土台を背景に、「複数クレカの支払いを一元管理したい」というユーザーのニーズを起点に、QR決済のような日々の支払いまでカバーした「支払い関連オールインワンアプリ」に進化したのであれば、ポジショニングとしてはかなり強いですね。

金融のデジタル化を本気で進めるのであれば、このような官民一体となったAPI連携の世界が重要だということを改めて実感します。

【新常識】効果抜群。「男性育休」はカネで解決できた

永吉 健一株式会社みんなの銀行 取締役頭取

男性の育休取得は当たり前の環境になりつつありますね。

出産直後に初めての経験に対する喜びや不安と向き合うという意味でも家族と過ごす時間はとても大切ですが、子どもと一緒にいる時間は振り返るとあっという間です。私も、既に社会人になってしまった子どもがいますが、今思えばサッカーや様々な体験を通じてもっと×3一緒にいる時間を作ればよかったなと思う次第です。

出産時の入口だけでなく、子育ての過程においても継続的に支援できる枠組みを企業や自治体が一体になって充実させていかないとダメですね。

そういう前提で組織としての意思決定やリソースコントロールをしていけば、企業の生産性はもっと向上するかもしれません。

ソフトバンク、自販機をDX化する「Vendy」を提供開始――キリンビバレッジの自販機で10月以降導入へ

永吉 健一株式会社みんなの銀行 取締役頭取

先日、コカ・コーラの自販機で手持ちの小銭やおつりを投入してアプリ(Coke ON)の電子マネーにチャージできるというニュースがありましたが、こちらは自販機ビジネスの裏側で業務を効率化するDXの事例です。

コンビニの進出などで年々台数が減少し、全国で400万台程度(2020年)にまでなっているとはいえ、銀行ATMの数が約18万台(ゆうちょ銀やコンビニATM含む)と比べてもその数は圧倒的です。

以前、アイデアで自動販売機が銀行のATMになったら?(カードをかざすとお札が出てくる)的なことを考えたこともありましたが、これだけ普及している電子機器の「箱」なので、まだまだ面白い取組みはできそうですね。

ステーブルコイン「テザー」、発行残高が1000億ドル突破

永吉 健一株式会社みんなの銀行 取締役頭取

3月に入ってビットコインやイーサリアム等が過去最高額になっています。海外では利益確定せずに、いったんステーブルコインに逃す需要がますます高まってきているようです。ただし、アメリカではステーブルコインの明確な規制が存在しない中で発行数が増え続けており、今後は規制されていくことも想定されます。

一方、日本では世界に先駆けて、ステーブルコインに関する規制が整備されました。銀行・信託銀行・資金移動業者が安全安心なステーブルコインを提供する基盤が整いつつあり、規制整備されたステーブルコインを活用し、日本が世界中の決済を担うことも期待されます。今後、どのようなユースケースを作っていけるのかも要注目です。

【これは便利】日帰り温泉・銭湯マップ「ゆる~と」が話題 - 「まとめた方、素晴らし過ぎます」「え、なにこれ最強じゃん温泉いこうぜみんなで」

永吉 健一株式会社みんなの銀行 取締役頭取

いよいよ温泉の情報プラットフォームがでてきたのですね!!

情報プラットフォームでは、その情報にいろいろな人が訪れ、さらに情報が重なり、また多くの人が訪れるようになり、また情報が増え、、、のサイクルで大きなデータベースが構成されます。

様々な領域に個々の情報プラットフォームがありますが、

例えば、飲食では食べログやぐるなびなど。登山では、弊社と提携しているYAMAPやヤマレコなど。そしていよいよ温泉でも!

インターネットで検索することで調べたい先の情報は調べられますが、情報プラットフォームの良さは、それにプラスしてユーザの声や評価がのり、客観的にみれ、判断の後押しにもなれること。温泉情報プラットフォームのゆるーとに声や評価が更に追加され使いやすくなることを期待させていただくとともに、

私個人としても、弊社のミッションである「みんなに価値あるつながりを」を実現すべく、改めて刺激を受けました。

NORMAL

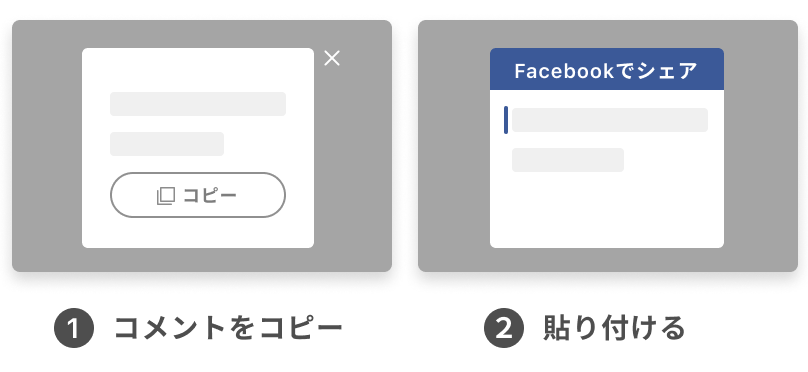

投稿したコメント