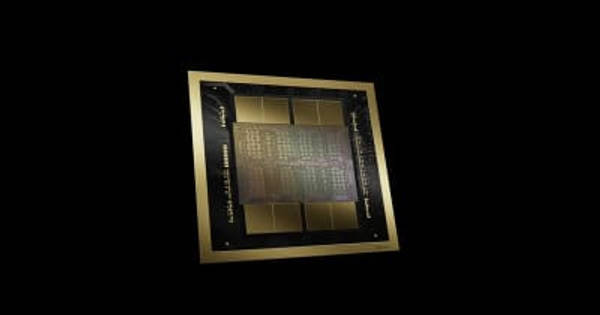

NVIDIA、1パッケージに2ダイの新型GPU「Blackwell」。AI性能は学習4倍、推論30倍に

コメント

選択しているユーザー

NV-HBI(10TB/s)がすごいですねえ。数千本単位のI/Oでチップ間を接続していると思いますがこれまで同様にCoWoS使ってるのでしょうか。Si Interposerも含めた協調設計環境を提供できるTSMCじゃないと実現が難しそうです。

注目のコメント

一体いくらになるか気になりますね。

大規模基盤モデルのサイズはAIチップの制約で決まりますから、さらに大規模化できることになります。

言語モデルなら緻密で複雑な推論や設計問題が解けるでしょう。また特に動画生成が実用レベルに向上すると期待したいです。発表会ではアマゾンのAWSが2万基のGB200で構成されたサーバクラスタを導入するという話も。27兆パラメータの大規模モデルが運用できるとのことで、コンピューティングパワーの向上でAIのさらなる進化も見られそうです

消費電力もまた半端ない向上でしょうし、サーバラックの熱処理も大変でしょう。無論それら全てサーバの価格、クラウド利用料に跳ね返ってくるわけで、ひいては益々パブリッククラウド御三家の株価が上がる要因にもなれば、企業や大学や国の研究機関でそれを払えるものと払えないものとの格差が益々広がる要因ともなるでしょう。