ChatGPT、“目”と“耳”の実装を発表 写真の内容を認識、発話機能でおしゃべりも可能に

コメント

注目のコメント

こうなってくると、いよいよ最適化された優れた「デバイス」が必要になってくると思います。そこが、オープンAIの1つの流れ角になってくるのではないかと思います。

というのは、Googleやアマゾン(やアップル)は、広く消費者に行き渡るデバイスを擁しています。

目や耳の競争が本格的になってくると、こうしたデバイスメーカーがより有利な展開になってくると考えているので、オープンAIはどのようにして、パソコン以外のデバイスを味方につけていくのか、と言う部分に注目しています。音声と画像を別々にリリースせず、同時にすることで、一気にユーザー体験を飛躍させる戦略ですね

画像認識は、音声やテキスト処理よりコストがかかるので、ChatGPTの価格が据え置きなら、OpenAIの財務的なチャレンジですね。

技術的には、

・音声認識:OpenAIが1年前に発表したオープンソースWhispier

・音声合成:新たに開発

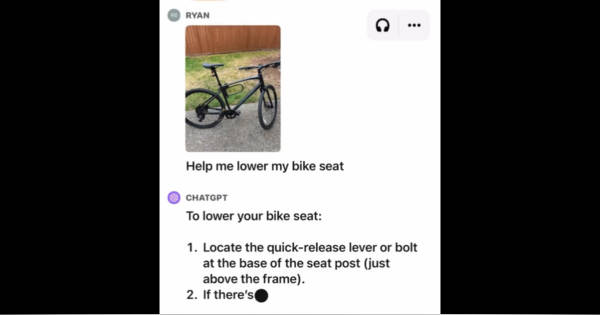

・画像認識:GPT-3.5, GPT-4これはすごい機能ですね。まるで自分のアシスタントのように画像と音声を理解し欲しい回答をくれます。

ホームセンター他、お店などでうまく使えば店員の仕事の代替になってくれそうだなと思いました。

画像をOpenAIにインプットしてヒントを得る、そのソースの多くはネット情報、ということで、ネット情報がOpenAIに表示されるような最適化が情報提供者には重要になってきそうですね。

最新のOpenAIのデモを公式X(Twitter)で見るとその凄さを実感できると思います!

https://twitter.com/OpenAI