OpenAIのクローラーをNew York Timesなどのペイウォールメディアがブロック開始

コメント

選択しているユーザー

米The New York Timesや日経新聞といった有料コンテンツを提供するメディアが、chatGPTのデータ収集アクセスをブロックしているとの報道について。個人的には複雑な思いがあります。。

当然、メディア各社が自社コンテンツの無断利用を懸念するのには十分に理解できます。AI研究の発展には大量のデータが必要不可欠ですが、知的財産権の保護も大切な課題です。今後、法的なグレーゾーンも多く出てくると思いますが、建設的な議論を重ねながらバランスを取っていくことが望ましいのではないでしょうか。

他方、データ活用を制限することで、結果としてAI開発のスピードが鈍化し、ひいては社会におけるAIの受容が遅れる可能性もあると危惧しています。日本は例えば絵画の著作権の場合研究目的では合法だった気がしますが、この場合は「極めて社会性の高い営利」ですので、関係者全員が複雑な心境でしょう、、

注目のコメント

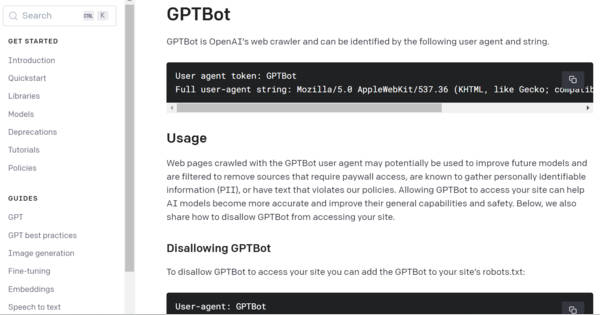

OpenAIのウェブクローラであるGPTBotがウェブサイト管理者の観測網に引っかかり始め、OpenAIがこのクローラを制御するのに必要な技術情報を公開したのが8月初頭。つまりOpenAIが公式に自前のウェブクロールを始めたのが8月に入ってからです。

なので現在各社がGPTBotをブロックし始めているのは、記事で挙げられているNYTの例のようなコンテンツ利用ポリシーの変更によるものというよりも、OpenAIがウェブクロールを始めたことに対する初動反応と見るべきでしょう。とりあえず生ならぬ「とりあえずブロック」といったところで、OpenAIにクロールされるメリットは無いと判断している事になります。

で、現時点で既に主要1000ウェブサイトのうち9%超、トップ100だと15%超が「とりあえずブロック」しています。

https://originality.ai/blog/study-websites-blocking-gptbot

非常に気になるのはCCBotが巻き添えを食らってブロックされ始めている点です。軽くチェックしましたがNYTは今年の4月、日経も8月からブロックし始めたようです。

CCBotはCommon Crawl(CC)という非営利団体が2013年から実施している大規模クロールのクローラで、世界中のウェブサイトから定期的に収集したページのアーカイブをAWS S3上でオープンデータとして公開しています。

CCのデータはGPTやStable Diffusionといった生成AIモデルの学習にも広く用いられています。Googleならずとも世界中から収集した大規模データを活用出来るようになったというウェブデータの民主化という点でCCの貢献は非常に大きいです。

ただChatGPT等の登場によって原著作物と競合するようなコンテンツの自動生成が広く利用可能となってしまったため、CCBotについても「とりあえずブロック」が広がるとなると問題です。CCのデータは生成AI以外にも学術を含む幅広い用途で利用されているからです。

この辺り、Google等はAI用途も含めたウェブデータ利用のきめ細かい制御のために現在robots.txtの拡張に取り組んでいるようです。全文検索にはヒットしないと訪問者が減るので悩ましいですね。AI学習だけをブロックするのは紳士協定に近いものがあります。

商業的には分かるのですが、ネット空間の知の構造化と民主化がどうあるべきか、という視点も大事でしょう。かつてWikipediaは人力を集めて世界中の知の構造化に挑みました。AIの助けを借りた、新たなAI Wikipedia的なサイトが登場する予感がします。有料サイトの情報を読んで要約して文章を生成するのはどう考えてもマズイですね。信頼できるニュースサービスの数はそんなに多くないので、法人取引を持ちかけてデータを読みにいけばいいんじゃないでしょうか?

"OpenAIは7月、ペイウォールのあるメディアの有料記事が読めてしまうという報告を受け、ChatGPT PlusのWebブラウジングを一時停止した"