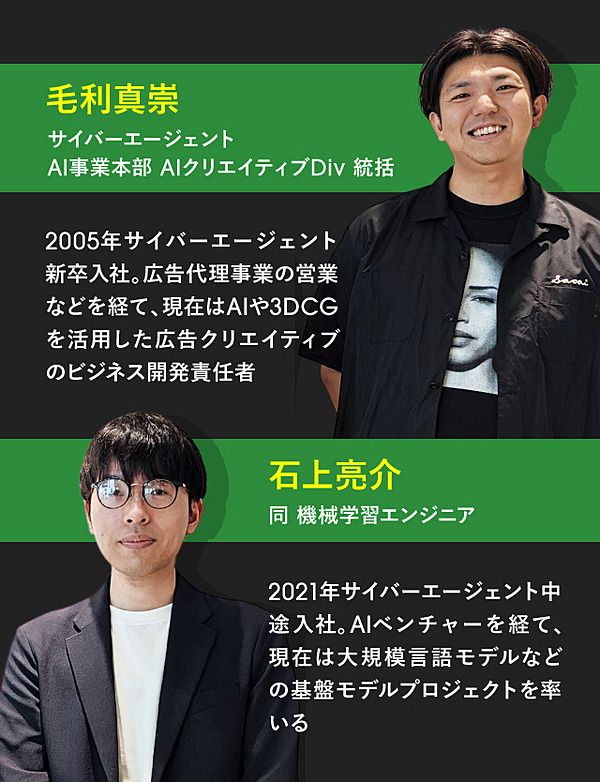

【舞台裏】サイバーが「大規模言語モデル」を生み出した必然

- LLMが必要だった根本理由

- 少量の追加学習でカスタマイズ

- OpenAIの論文が契機に

- 「AIコピーライター」の実力

- モデルの大規模化を阻む課題

- 富岳のプロジェクトにも協力

プレミアム会員限定の記事です

今すぐ無料トライアルで続きを読もう。

オリジナル記事 7,500本以上が読み放題

オリジナル動画 350本以上が見放題

The Wall Street Journal 日本版が読み放題

JobPicks すべての職業経験談が読み放題

学習データが肝なので、その視点で要約してみます。

1. 大規模言語モデル(LLM)

・一般公開した68億パラメータのモデルは、Wikipedia とCommon Crawl (自動収集可能なウェブサイトの公開データ)を学習

・社内限定の130億パラメータのモデルは、広告などの自社データも学習

・日本語の言語データは英語に比べて、公開されているものが少なく、国に期待している

→日本語の公開データでは、68億パラーメーターが限界なのかも

2. 追加学習 (ファインチューニング)

LINEやFacebookなど媒体ごと、金融や美容などの業界ごとに、広告効果の高い(クリックされやすい)コピーを学習

→これが広告に特化したモデルの強み

和製LLM(大規模言語モデル)が、GPT-4などの海外LLMと比べてどうオリジナリティを出すべきかが気になっていましたが、この記事を通して、その筋が見えてきたような気がします。

あくまで私の解釈ですが、サイバーさんのモデルは、日本語生成の点において海外モデルに対抗することを目的としたものではなく、広告コピー生成というニッチ領域で日本人に最適化した「ドメイン特化モデル」であることに気付きます。

マーケティング観点では、「広告コピー」と一言で言っても、やはりターゲットに好まれる文言や、媒体・チャネルごとによく使われる表現、他のコンテンツとの競合性など、多くの要素を加味した上で作成する必要があります。

サイバーさんのLLMは、単なる汎用的な「生成AI」という枠を越えて、適した学習データを用いることでマーケティング機能を持たせ、「生成AIによる最適化」にまで踏み込んでいる点に価値が見出されます。

こう見ると、やはり産業特化・地域特化・ビジネスドメイン特化など、ニッチな部分に特有のデータを収集・学習させ、汎用的なLLMでは出力できないような解を出力させる点に、残念ながら世界的には開発に出遅れてしまった和製LLMの勝ち筋があるのだと思います。

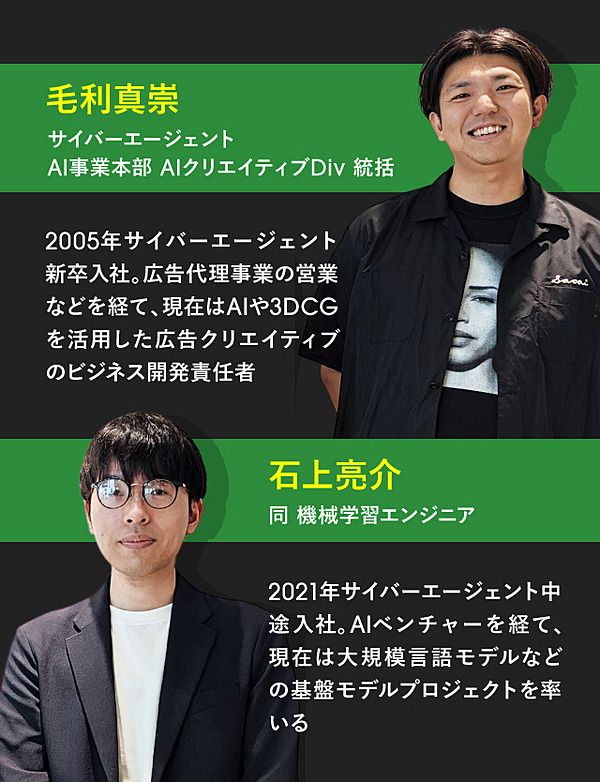

一方、記事内で石上さんも触れておられますが、こうした産業データ・ビジネスデータの収集を、いかに国が主体となって進めるかが大きな課題です。一企業で集められるデータ量には限界があり、利害も絡んでくるため、政府やアカデミアが主となって、共通データ基盤を作るような動きが、いま求められていると強く感じます。

広告コピー生成というタスクは多様な業界や媒体ごとに的したクリエイティブを作成する必要があるが、それぞれで十分な生成モデルを学習させるだけの大量のデータを収集することは大変困難である。

そこで、特定のドメインに限定しない大量のデータを学習させることで一般的な知識を獲得させた基盤モデルを生成し、タスクごとには比較的少量のデータを追加することでよりその業界や媒体に適したコピーを生成することを可能にする。

大規模言語モデルの作成モチベーションが事業に直結しており、実際に運用もされている素敵な事例だと思いました。

マイニュースに代わり

フォローを今後利用しますか