Meta、耳にした単語を脳波から推測するAIモデル開発--「考えただけで文章を作る」未来か

コメント

注目のコメント

数週間前に私も関連した研究についてブログに書きましたが(https://ashibata.com/2022/08/21/sentience/)このような研究は10年以上前から行われていて、これまではfMRIという脳の中の血流を使ったデータが使われていました。その当時の研究でも、コミュニケーション能力を完全に失った脳死患者との会話に成功していて、植物状態の患者の2~30%は実際には意識があると推定しています(https://www.latimes.com/archives/la-xpm-2010-feb-04-la-sci-vegetative4-2010feb04-story.html)

今回の研究では脳波・脳磁場という少し種類の違うデータを使っていていますが、このほうがデータが取りやすいということなのかどうかは不明です。調べてみるとやはりこれらのデータを取るにも非常に大きな煙突のような検出器をかぶる必要があるようです。

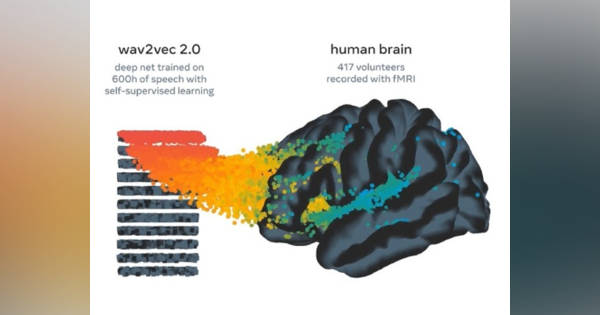

面白いのは、もともと人間の脳を模して(そんなににてないとは言われているが)設計されたディープラーニングを使って人間の脳を読み出すことが可能になっているということですね。父親の最後の1年間。

寝たきりになってしまい話せなかった。

あの時、父親が何を思っていたのか今でも知りたいと思うときがあります。

本当にこういう技術が実現したら良いのにな。Metaは、次世代ユーザー・インターフェースの覇者を目指しているので、ブレインテックへの投資は必然なんでしょうね。

旧Facebookは、脳にデバイスを埋め込む必要のない非侵襲型のブレインテック企業CTRL-labを2019年に買収して、この領域に本格的に参入しました。

ただ、非侵襲型をうたいつつ、脳にデバイスを埋め込む侵襲型の研究も発表したりと、試行錯誤を続けているようですが、今回は当初の目論見の通り、非侵襲型の成果を出せたようです。