Copilot for Microsoft 365の「ここが危険」、誤った活用法では社外秘が筒抜けに

コメント

注目のコメント

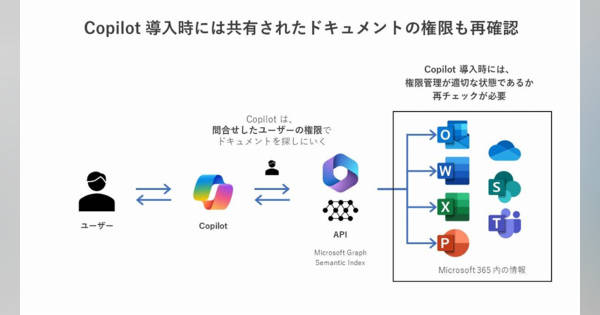

情報漏洩対策の基本は、①守るべきデータ資産の特定、②それらに対する適切なアクセス権の設定、③適切に運用されているかの監視、の3つです。

Copilotも、ファイルに定義した秘密度ラベルに沿って文書を作成していくとのことですので、これら3つの対策の基本を守れば、AIによる情報漏洩のリスクも避けることができるでしょう。AIの問題というよりは、資料そのものの制限の掛け方の話ですが、秘匿性の高い情報は管理の仕方だけではなく、デジタル上のアクセスのされ方も注意したほうが良いです。

AI自身が一人の人。と考えると、資料の内容を話して良いのか。そのAIが他人にその内容を話さないか。など気をつけるポイントが見えてきます。まーたこの話か。chatgptの時に大騒ぎした話。

Microsoftをある程度信頼するしかないかなーと個人的には思います。

社内外との壁は、情シスやらなにか専門家が対応できるけど、それより、社内のインサイダー情報とか人事情報とかこそ、使う人のリテラシーの高さが求められると思う。そしてそこには比較的低い人たちが多い。