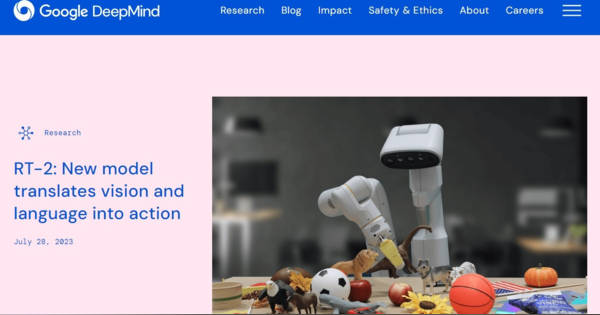

Google DeepMind、ロボットの行動を改善する新VLAモデル「RT-2」発表

コメント

選択しているユーザー

Google DeepMindの新VLAモデル「RT-2」についての記事。これは確かに一歩前進ですね!

しかし、重要なのはこれがどのように現実世界で機能するか、という点だと思っています。

僕が特に気になるのは、このモデルがどの程度の誤解や不確実性を許容できるか、そしてどの程度の効率で学習できるか、といった部分です。現実世界はノイズが多いし、予想外のことが起こることも少なくないので!

僕はこの進歩を楽観的に見ています!続報が楽しみです!

注目のコメント

視覚と言語の情報からアクションを生成する新しいAIモデルです。特に常識を学習した大規模言語モデルを使って、未知のタスクについてアクションを生成する能力が飛躍的に向上したようです。

ただこの手のデモは、生活シーンを題材にするので、本当に直近必要な働く現場のロボットでどこまで使えるのか分かりづらいです。典型的には、食品工場や建設現場でしょう。もっともロボットアームがモノを掴んだり、操作する性能がまだ不十分なので、問題を切り分けるために仕方ない面はありますが。