ホーム

20フォロー

15148フォロワー

イーロン・マスク氏のxAI、LLM「Grok-1」をオープンに

佐々木 励AI Venture - AI Brain Explorer

> 3140億パラメータのMixture-of-Experts(MoE)

オープンLLMとして最大パラーメータ数は、Meta社のLlama 2の700億なので、その4倍以上ですね。スケール則が成り立つなら、賢さも4倍。

Mixture-of-Experts(MoE)は、GPT-4なども採用していると噂される、単一のネットワークではなく、複数の専門特化モデルを組み合わせるアーキテクチャ。

公式サイトには、ベンチマークでの性能評価はなく、今後の発表や第三者による比較が待たれる。

https://x.ai/blog/grok-os

【直撃】フィグマCEO、生成AI時代はデザインが勝敗を決める

佐々木 励AI Venture - AI Brain Explorer

「デザインを自動生成する生成AIがフィグマのビジネスを破壊する懸念はないのか」

デザインを生成AIで自動化しようと実験してました。その結果、

・UXデザイン:生成AIで自動化しやすい

・UIデザイン:生成AIで自動化しづらい

UXデザインでは、ターゲットユーザーを誰にすべきか、どういう価値を提供すべきか、ユーザーの感情はどう変化するかなど、概念的な思考が多いです。それは言語と相性がよく、言語生成AIが得意です。

一方、UIデザインは、ボタンをどこに配置するか、入力フィールドにどんな制約を課すかなど、細かな設定が多く、それら全てを言語で指定するのは大変。GUIは、視覚的であることに価値があり、デザイナーの視覚的な試行錯誤が必要。少なくとも、いまの言語生成AIや画像生成AIでは難しそうでした。

Gemmaの技術レポートを読み解く〜Google初のオープンLLM

佐々木 励AI Venture - AI Brain Explorer

Googleが、生成AIの基盤である大規模言語モデル (LLM) として、「Gemma」を発表しました。Googleとしては初のオープンなLLMです。

Gemma は、マルチモーダル生成AIのGemini からインスピレーションを受けており、その名前はラテン語で「宝石」を意味するgemmaを反映しているそうです。

そこで、Gemmaの技術レポートをベースにしつつ、足りない情報をLlama-2の論文やGeminiの技術レポートで補いながら、多角的に技術レポートを読み解きます。

具体的には、オープンなLLMの代表格であるMeta社の「Llama-2」、Llama2を超えたとして頭角を表したフランスのMistral AI社の「Mistral」に加えて、LLMのトップランナーであるOpenAIの「GPT」、Google DeepMindの虎の子である「Gemini」などと比較します。

NORMAL

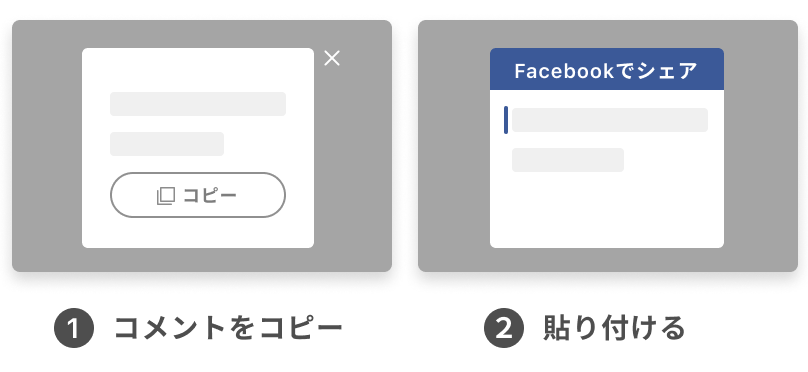

投稿したコメント