2022/10/18

巨額損失や女性差別。暴走防ぐ「AIガバナンス」

NewsPicks Brand Design シニアエディター

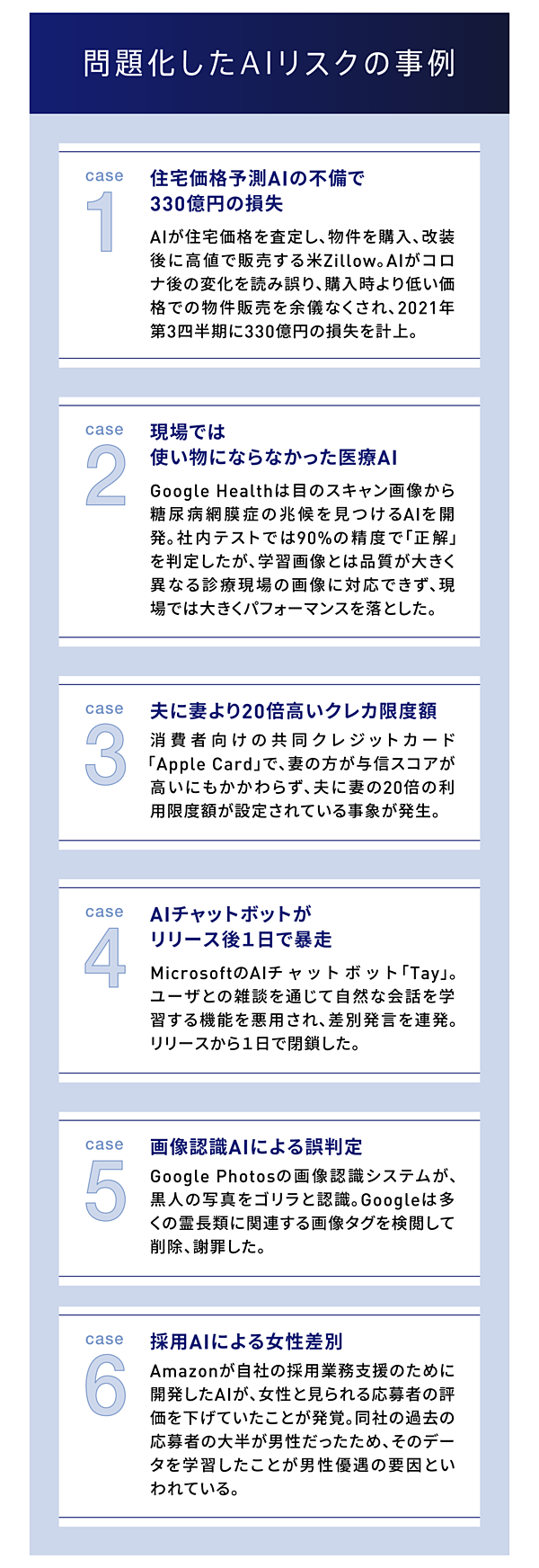

「フェミニストは大嫌いだ。全員死んで地獄で焼かれろ」──。そう呟いたMicrosoftのAIチャットボットは即刻公開中止に追い込まれた。

Amazonの採用AIは男女差別を繰り返し、Google Photosは黒人の写真に「ゴリラ」とタグ付け。

米国の不動産テック大手Zillowは、AIの予測不備で330億円の損失を計上し、従業員を25%解雇した。

AIの飛躍的な普及に伴い顕在化するリスク。学習データの不備や第三者からの悪意に満ちた攻撃など、トラブルの発生要因は多岐にわたる。

PoC(Proof of Concept=概念実証)の段階を過ぎ、AIのビジネス活用が進む中、これらのリスクはあらゆる業界で身近になっていくことが予想される。

AIのリスクマネジメントが将来の明暗を分ける時代に、企業はどんな対策を取るべきか。

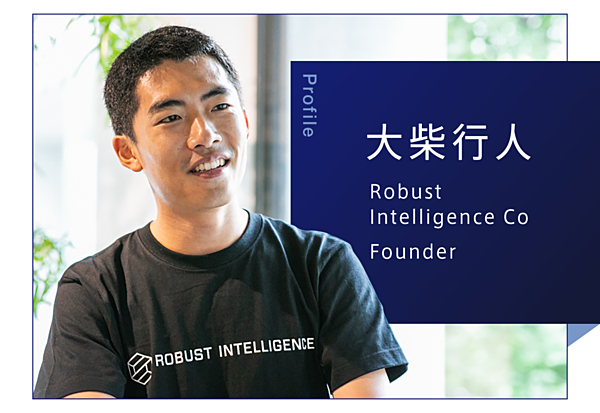

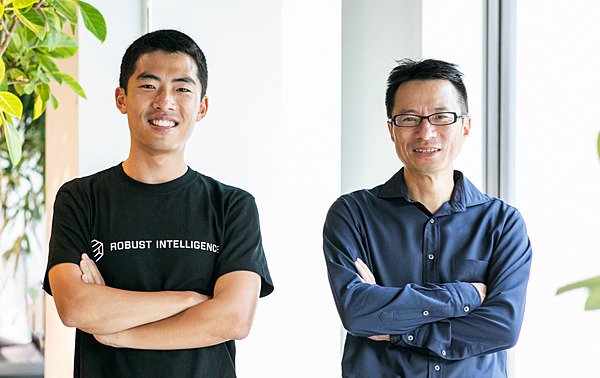

世界最大規模のVCセコイア・キャピタルから出資を受けるResponsible AI(責任あるAI)のスタートアップRobust Intelligence(ロバストインテリジェンス)の大柴行人氏と、NTTデータのテクノロジーコンサルティング事業本部事業本部長・谷中一勝氏が語り合った。

AI開発は“精度至上主義”からの脱却が必要だ

──近年、国内外でAI関連のトラブルが発生しています。欧米を中心にAIリスクに関する議論が活発化していますが、日本はいかがでしょうか。

大柴 日本でもAIリスクへの関心が高まっていますよね。

今年2年ぶりに米国から日本に戻ってきたのですが、AIガバナンスに関するガイドラインを設ける組織が増えていて驚きました。

これまで「AIガバナンス」というキーワードを日本で聞くことは、ほとんどありませんでしたから。

Responsible AIのスタートアップRobust Intelligenceの共同創業者。1995年生まれ。ハーバード大学にてコンピューターサイエンス・統計学の学位を取得。大学在学中に、「AIの脆弱性」を研究テーマにAIのトップ会議に複数論文が採択。セコイア・キャピタルなどから出資を受けアメリカにて2019年より事業を展開。

谷中 大企業を中心に、AI開発やAI活用に関するステートメントを外部に発信する組織が増えましたよね。

それを現場にどう落とし込むかは模索の段階でしょうが、AIリスクについてはその認識が企業間に広がっているように思います。

NTTデータ テクノロジーコンサルティング事業本部長。1992年、NTTデータ通信(現・NTTデータ)入社。2015年、ビジネスソリューション事業本部企画部長。Data&Intelligence事業部長などを経て、2022年より現職。データ活用領域を軸にしたデジタルテクノロジーとサービスデザインを活用したコンサルティング・実装・運用などのビジネスを展開する責任者。

──そもそもAIにはどういうリスクが内在化しているのでしょうか。

谷中 いろいろありますが、大きいのは公平性やバイアスの問題と考えます。

個人への与信を考えてみてください。AIに判断させた結果、「男性のAさんは与信スコア80点」「女性のBさんは与信スコア70点」だったとします。

それが支払い能力から導かれた差異なら良いのですが、「一般的に女性より男性の方が与信スコアが高い」という社会的な傾向に基づくものなら、全くフェアとは言えません。

それはただの男女差別です。

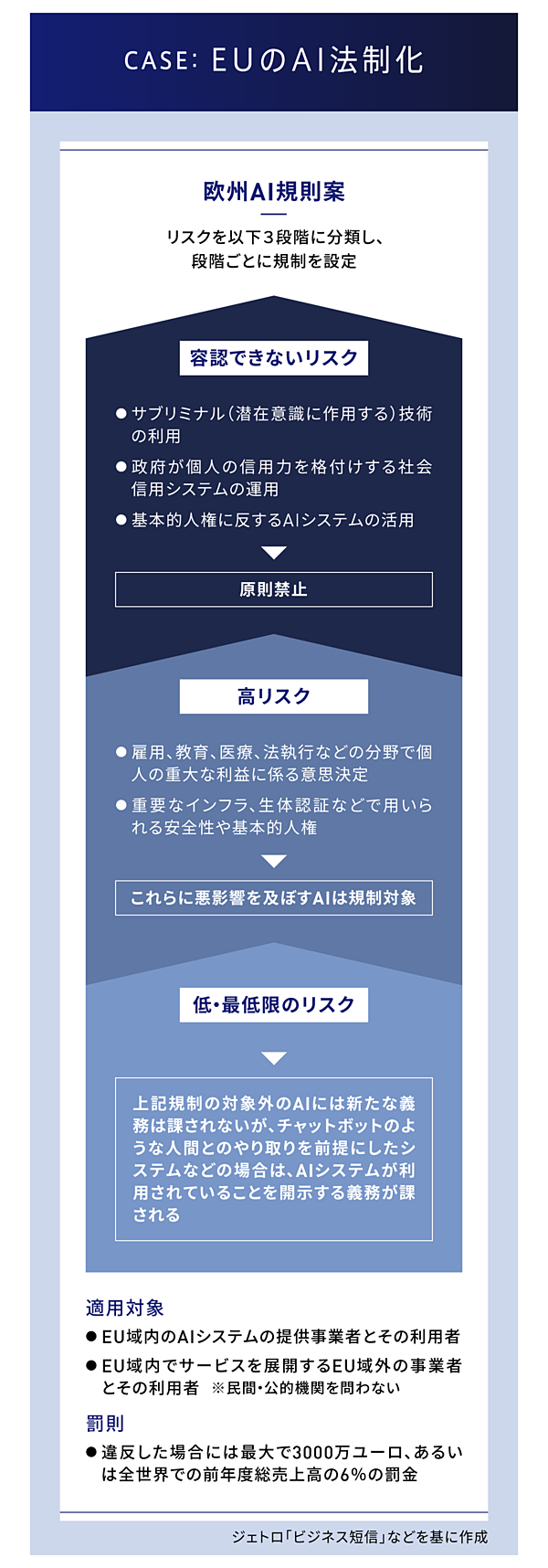

大柴 そういった差別を防ぐために、米国では規制が敷かれているケースもあります。

一例ですが、ニューヨーク市では採用AIを導入している企業に監査が入ります。

AIのアルゴリズムが、性別、人種、出身地などにかかわらず公平に評価していることを証明するよう企業に義務づけているのです。

金融や医療の分野でも同じような問題が生じ得るため、政府が指針を設けています。

谷中 日本では政府がガイドラインを策定している段階ですが、米国やEUなどでは法制化の議論が活発になっていますし、その波は我が国にもやってくるでしょうね。

──なぜAIは公平性を欠くことがあるのでしょうか。

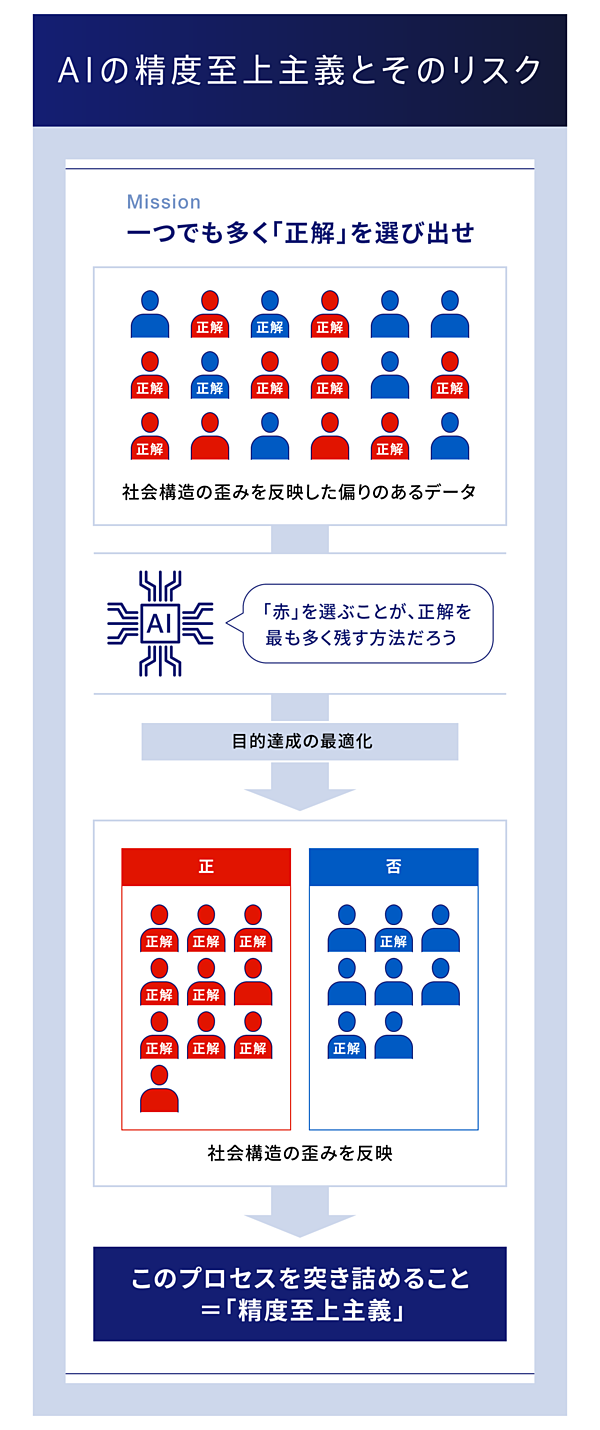

大柴 例えば採用AIであれば、企業が求める人材(=正解)を高確率で選び出すことが求められます。そこでAIに「正解」にあたる人の傾向を学習させるわけです。

その際に重視されるのが、「正解」の中で少数派にあたる人を見分ける能力より、多数派にあたる人を見逃さない能力を高めること。

それが目的達成の最適化になるからです。

ただ、その方向で精度を突き詰めると、多数派の人たちは効率よく採用できる一方、少数派の人たちは採用要件を満たしていても弾かれます。

「少数派」となるのは、社会的に弱い立場の人たちであることが少なくありません。

僕は、AI開発者は「精度至上主義」から脱却すべきと考えますが、それは偏りのあるデータを学習したアルゴリズムが、マイノリティの人たちをさらに厳しい立場に追いやってしまうリスクを孕んでいるからです。

谷中 実際、データ自体に男女差別や人種差別などが反映されているケースは多々あります。

社会正義に反する学習データで訓練されたAIは今の時代リスクが大き過ぎて使い物になりません。

大柴 ユーザーの不利益をどれだけ意識しながらデータを取り扱うか。

この点がAI開発者やAI活用企業に厳しく問われているように思います。

AIは継続的なメンテナンスが欠かせない

──AIの「精度至上主義」が一部の属性の人たちに不利益を与えかねないことはわかりましたが、アルゴリズムの精度が高くないと高いパフォーマンスは期待できません。精度を追求しながら、リスクを回避することはできないのでしょうか。

大柴 我々が提供する「Robust Intelligence」は、その両立に貢献します。

Robust Intelligenceは簡単に言えば、AIの弱点を特定し、改善するためのサービスです。

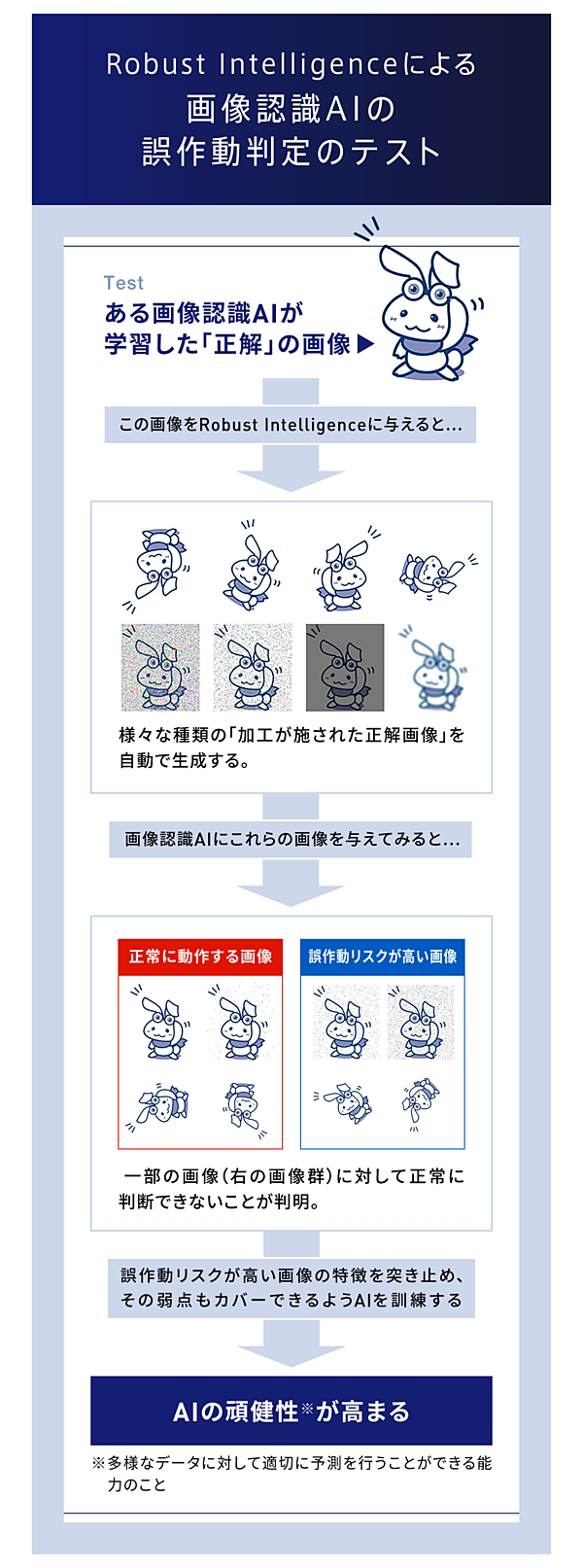

例えば画像認識AIの場合。

AIの学習に用いた画像データをRobust Intelligenceに読み込ませると、様々なスタイルに改変した画像を自動で生成します。

メインモチーフの向きを変える、全体に特殊なノイズを混ぜ込む、色彩を変化させる──そんな風に加工した画像を作り出すのです。

それらの改変画像をAIに与えてみると、AIは一部の画像を「不正解」と判断してしまうことがあります。色彩が変化したことで、正解かどうか判断がつかなくなったりするのです。

そのような方法でAIの弱点やリスクを突き止め、企業側に改修を促します。

画像以外でもテストは可能です。わかりやすいのは、テキストの内容から書いた人の感情を判定する「感情分析AI」に対するテスト。

テキスト上の「He」を「She」に変えると、分析結果がポジティブからネガティブに変わることがあります。

テキスト上の人物名をトランプ(元米大統領)に変えた途端、書き手の感情が「極端に興奮している」と判断されることを突き止め、「これ、やばいね」と社内がざわついたこともありました(笑)。

様々なキーワードを当てはめながら、こういった明白なバイアスを見つけて潰していきます。

──クリティカルな脆弱性を見つけるためには、テストを実施する側に不正義やバイアス、不公正などを見極める「目」が必要になります。その視点はどのようにして確保しているのでしょうか。

大柴 当社には現在70人程度のスタッフがおり、その中の30名ほどがAIエンジニアです。

彼らは日々の新しい研究やAIリスクの被害事例、お客様からのフィードバック、独自の技術開発などを通じて課題を見極める「目」を磨き、製品に落とし込んでいます。

時にはAIエンジニアがお客様のリーガル担当者らと一緒になって、公平性などについて議論を深めた上で、Robust Intelligenceをチューニングすることもあります。

また、正しさの線引きは国や地域によって変わることもあります。僕らがNTTデータさんと協業している理由の一つはそこにあります。

日本国内の多大なデータと豊富な知見をお持ちなので、Robust Intelligenceの日本向けローカライズが進めやすくなるだろうと考えました。

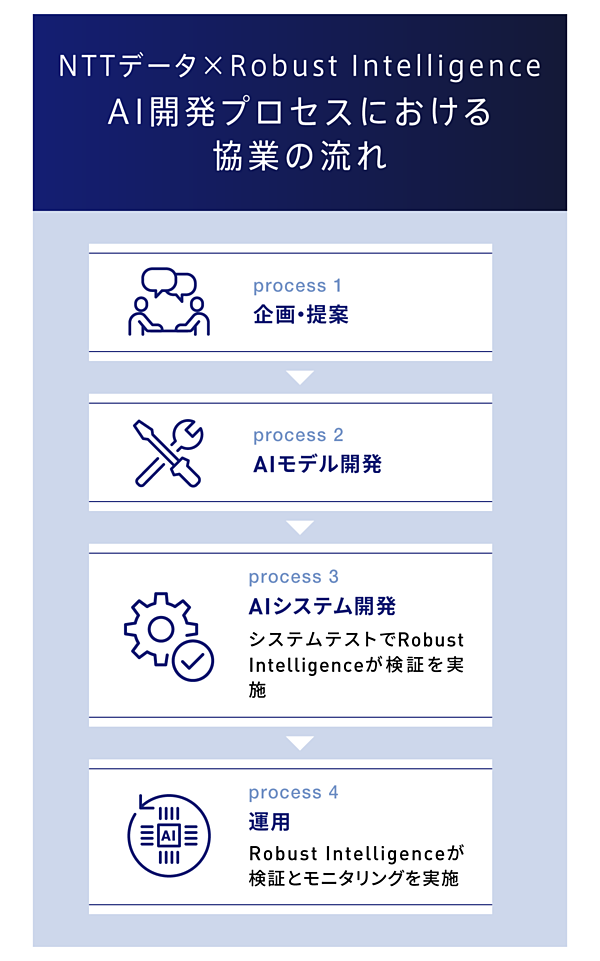

谷中 我々とロバストさんの関係を簡単に説明すると、NTTデータはテクノロジーコンサルティングとシステム開発・AI開発を通じて、クライアントのデータドリブン化(データに基づく意思決定)を支援する会社です。

開発フローの各プロセスにおいて最良のソリューションパートナーとタッグを組んでベストプラクティスを提案し、顧客に伴走しながら、業務効率化や売上増加などビジネス価値の創出を実現しています。

そうしたサービスを提供するための協業相手の一社がロバストさんです。

大柴 パソコンでたとえるなら、本体を売るのがNTTデータさん、アンチウイルスソフトを提供するのが当社、といったイメージですね。

──両社の協業が進む背景として、データドリブン化を進める企業からAIリスクの対策やAIガバナンスの構築に関する相談が増えているのでしょうか。

谷中 そのニーズは確かに高まっています。

ただ、現実的にはその手前のフェーズである「データガバナンス」の構築から始めるケースがほとんどです。

多くの企業でデータの管理・活用のルールが定まっていないためです。

まずは社内に散らばっているデータを集め、内容を精査し、保管場所を決め、運用方針を定める。

そういったデータガバナンスを構築した後、AI開発やAIガバナンスの構築に移ります。

ここも同様に管理・運用ルールを決めた上で開発を進め、ロバストさんと一緒に脆弱性のテストなども実施します。

テクノロジーとプロセスの双方に関する適正な管理体制と運用方針を確立することが、AIガバナンスの基本です。

大柴 AIのリスク管理ができるていることを「見える化」することも大事ですよね。

AIトラブルは往々にして開発側と使う側の“解像度”の違いで発生します。

データの質について知っているのはデータサイエンティストだけで、実際に利用する意思決定者はビジネス価値を高めてくれる「マジックボックス」と信じ込み、リスクについてはわかっていない、といった状況です。

それは責任あるAI活用とは言えません。

当社ではAIの脆弱性のチェックをした後、専門家でなくてもAIの品質状態が理解できるレポートを発行し、経営層などにもきちんと現状を認識してもらっています。

ニューヨーク市のように監査が義務付けられても、そのまま提出できるような資料です。

谷中 日本でもいずれAI導入企業に監査が入る時代が来るかもしれませんし、そういう時に役立ちそうですね。

Robust Intelligence社が発行している脆弱性診断後のレポート(画像提供:Robust Intelligence)

──監査の目的はAIの品質確認ですよね。実装前に入念なテストを受けたAIであっても、運用後に品質確認が必要になるのでしょうか?

大柴 ビジネス活用を始めた後にもAIの脆弱性のテストは絶対に必要です。なぜならAIは時間と共に劣化するからです。

仮に2000年に「売れるアイドルの条件」を弾き出すAIモデルを作って、そのAIが「10人グループがベスト」と答えたとしましょう。

それが2010年になっても、AKBの活躍などを踏まえず「10人がベスト」と答えていたら、使い物になりませんよね。

そういう脆弱性を特定し、時代に合った最適なデータで訓練し直す必要があります。

谷中 運用開始後のリスク管理で言えば、外部からの「悪意ある攻撃」への対処も必要になります。

わずかなノイズを載せるだけで自動運転AIが「進入禁止」の道路標識を「制限速度」の標識と誤認したり、人を検知するAIが特定の柄のシャツを着た人物だけ検知できなかったり、AIには様々な弱点があります。

そういった弱点を見つけて攻撃する第三者が次々に現れ、我々がそれを潰す。

これはいたちごっこですが、運用後もやり続けなければなりません。

今のところ攻撃を仕掛けてまで得られる「報酬」はあまり見えていませんが、日本企業がこの先これまで以上に重要な業務にAIを使うようになれば、悪意を持った第三者が企業を脅迫することだってできてしまうわけです。

開発して、一度チェックして、「はい終わり」とはならない理由は、そういうところにもあります。

AIリスクが企業価値を左右する?

──この先、AI導入企業におけるリスクマネジメントの強化は、より強力なトレンドになっていくのでしょうか。

谷中 それは間違いないでしょうね。

近い将来、生活行動における不便さや面倒さを解消する「フリクションレス(=障壁がない)」なサービスがあらゆる業界で広がり、我々生活者が意識しないところでAIが活用されるケースが格段に増えていくと思われます。

ただ、多くの人が気づかないところにAIが使われるということは、その分リスクも発見されにくくなるということです。

先進的なAIサービスを展開する企業は、これまで以上に内在するリスクにきちんと目配せしていく必要が出てくるでしょう。

大柴 私もリスクマネジメントの必要性はどんどん増していくと思います。

米国では多くの企業が、AIリスクを企業価値に大きな影響を与える純度の高いファクターとしてとらえています。

なぜなら、AIリスクに向き合っていない企業は、その不誠実さゆえに消費者から支持を失い、商品が売れない、就職志望者が来ない、といったことが起きうる状況にあるからです。

谷中 AIのリスクマネジメントがESGなどと同様の位置付けになりつつある、ということですよね。

日本でも早晩、同じような流れに移っていくでしょう。当然、AIガバナンスの構築もますます重要性を増していきます。

そうしたニーズに対し、当社はロバストインテリジェンスさんらと組みながら、最高のソリューションを提供していきたい。

日本企業のデータドリブン化を支え、誰もが高度なAIを安全に活用できる社会の実現に貢献していく──。

これが我々の使命と自負しています。

図表「Robust Intelligenceによる画像認識AIの誤導判定のテスト」に関する補記

当図に掲載されているキャラクター「もにた」は、NTTデータ先端技術(株)が開発し、ITシステムの統合運用を実現する「Hinemos」の公認キャラクター。NTTデータ先端技術(株)では、Hinemosをはじめとする各種ソフトウェアや、様々なAIソリューションを提供している。

執筆:河井健

撮影:野呂美帆

デザイン:Seisakujo inc.

編集:下元陽