ITmedia NEWS >

AI+ >

“歩きスマートグラス”でビデオ会議 横顔の映像を正面顔にリアルタイム変換:Innovative Tech

» 2021年02月02日 07時00分 公開

[山下裕毅,ITmedia]

Innovative Tech:

このコーナーでは、テクノロジーの最新研究を紹介するWebメディア「Seamless」を主宰する山下裕毅氏が執筆。新規性の高い科学論文を山下氏がピックアップし、解説する。

マックス・プランク情報学研究所とミュンヘン工科大学によるドイツの研究チームが開発した「Egocentric Videoconferencing」は、眼鏡型デバイスのフレームに取り付けたカメラから横顔の映像を撮影し、正面から見た顔の映像をリアルタイムに生成する、深層学習を用いたシステムだ。イヤフォンとマイク付きスマートグラスに搭載すれば、歩きながらハンズフリーでビデオ会議も可能という。

ビデオ会議では通常、PC、タブレット、スマートフォンなどで正面方向から顔を撮影しながら行わなければならない。歩きながら会議に参加する場合は、手持ちしたスマートフォンで自撮りし続ける必要がある。これは手が疲れるだけでなく危険でもある。

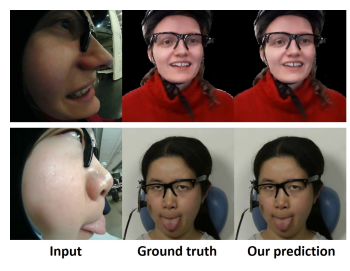

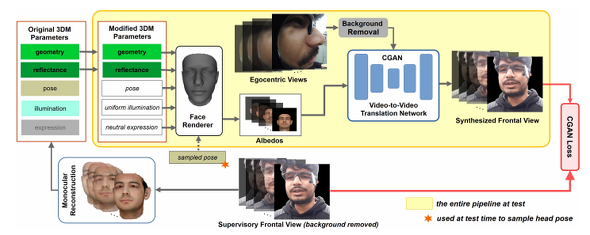

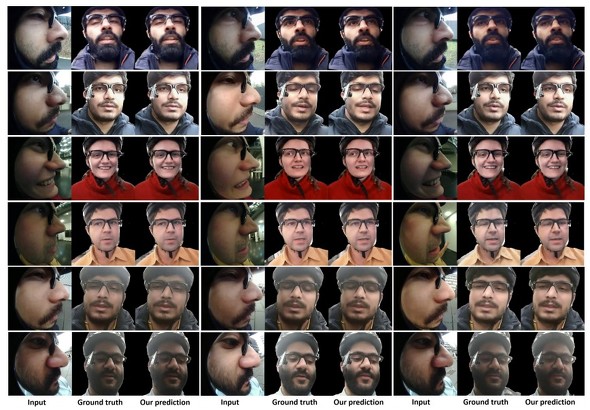

今回の手法では、眼鏡フレームに取り付けた魚眼レンズ搭載カメラで横顔映像を撮影し、正面の顔画像を生成する。

カメラから撮影した横顔は、Conditional GAN(条件付き敵対的生成ネットワーク)を用いて訓練したネットワークで正面の顔に変換する。顔の造作と髪型などは、あらかじめ用意しておいた中立的な表情を持つ顔の3Dモデルを変化させる。

このシステムでは正面から見た頭部と上半身をリアルな品質で合成し、頭や口の動き、視線、まばたき、舌、微妙な表情まで細部にわたってレンダリングする。さまざまな照明条件下でも合成可能で、音声と同期した唇の動きを出力する。

関連記事

スクリーンが動いても高速追従 液体レンズを使ったAFプロジェクションマッピング

スクリーンが動いても高速追従 液体レンズを使ったAFプロジェクションマッピング

動的なプロジェクトマッピングで課題となっていたフォーカス問題を解消する。 20機の小型ロボット群をハンドジェスチャーで直感操作 スタンフォード大など開発

20機の小型ロボット群をハンドジェスチャーで直感操作 スタンフォード大など開発

群ロボットの操作を不慣れなユーザーがしやすいようにした。 一般人が撮影したネット上の写真から建物を高品質に3D化するGoogleの機械学習技術

一般人が撮影したネット上の写真から建物を高品質に3D化するGoogleの機械学習技術

観光客が撮影してネットで公開している写真を利用できる。

関連リンク

Copyright © ITmedia, Inc. All Rights Reserved.

Special

PR